Ao longo deste glossário, exploramos como a inteligência artificial está revolucionando o mundo: máquinas que aprendem e níveis de segurança nunca antes imaginados. Mas, por trás de todo avanço, surge uma questão central: como garantir que essas tecnologias trabalhem a favor das pessoas, e não contra elas? Como garantimos a ética na IA?

Esses medos não são nenhum pouco infundados. Nos últimos anos já vimos algoritmos que perpetuam preconceitos, sistemas que priorizam lucros sobre pessoas e decisões automatizadas que, muitas vezes, não conseguimos explicar.

E, diferente dos algoritmos, a ética é humana. São os valores e escolhas das pessoas que guiam a criação e o uso da tecnologia. Por isso, a IA precisa da ética ao seu lado — não como uma barreira, mas como uma aliada essencial para garantir que todo avanço tecnológico seja justo, transparente e responsável.

Neste artigo, vamos falar sobre 10 maneiras práticas de garantir que a IA seja usada de forma ética, enfrentando esses desafios de frente. Porque, no final, a tecnologia só faz sentido se for usada para construir um futuro mais justo e seguro para todos.

1. Definir diretrizes claras para a ética na IA

O primeiro passo para garantir a ética na inteligência artificial é estabelecer diretrizes claras e bem estruturadas. Resumindo: significa criar um conjunto de princípios que orientem todas as etapas de desenvolvimento, implementação e uso da tecnologia na sua equipe.

Por que isso é importante?

Sem diretrizes, as decisões podem ser tomadas de forma inconsistente, abrindo espaço para problemas éticos como vieses, violações de privacidade ou uso indevido da tecnologia. Diretrizes sólidas criam um norte, assegurando que as soluções sejam desenvolvidas de forma justa, responsável e alinhada aos valores da empresa.

Como fazer na prática?

1. Criação de um código de ética para IA

Use uma linguagem simples e defina princípios como transparência, equidade e responsabilidade — também certifique-se de que ele seja compreensível e aplicável por todas as equipes envolvidas.

2. Baseie-se em normas globais

Inspire-se em normas reconhecidas, como a ISO 38507, que ajuda a integrar ética e governança à IA.

3. Integre a ética ao processo de design

Não espere até a etapa final para considerar questões éticas. Traga essas discussões para o início do projeto.

4. Eduque as equipes envolvidas

As diretrizes só fazem sentido se todos entenderem e seguirem. Promova workshops e treinamentos para reforçar os valores.

2. Garanta a qualidade de dados para evitar vieses na IA

Imagine construir uma casa: se a fundação for frágil ou mal planejada, não importa quão bonitos sejam os acabamentos — a estrutura sempre estará em risco. O mesmo acontece com a inteligência artificial: os dados são a base, e garantir sua qualidade desde o início é o que sustenta todo o funcionamento ético e eficaz da IA.

Por que começar pela base?

Corrigir problemas de qualidade nos dados depois que a IA já está em funcionamento é sempre mais caro e complicado. Por isso, garantir que os dados sejam bem coletados, organizados e limpos desde o início não é apenas recomendável, é essencial. Uma base sólida de dados reduz falhas, evita decisões enviesadas e aumenta a eficiência do sistema.

Como garantir qualidade na preparação?

- Pergunte o porquê: antes de coletar dados, questione o propósito. Quais decisões serão tomadas com essas informações? Dados irrelevantes ou redundantes só atrapalham;

- Trate os dados como um ativo valioso: invista em ferramentas de coleta que sejam precisas e automatizadas, e padronize formatos desde o início;

- Diversifique na origem: dados que representam apenas um grupo podem enviesar os resultados. Amplie as fontes para incluir diferentes perspectivas;

- Valide à medida que avança: a cada etapa, faça uma verificação de integridade e elimine dados inconsistentes ou duplicados.

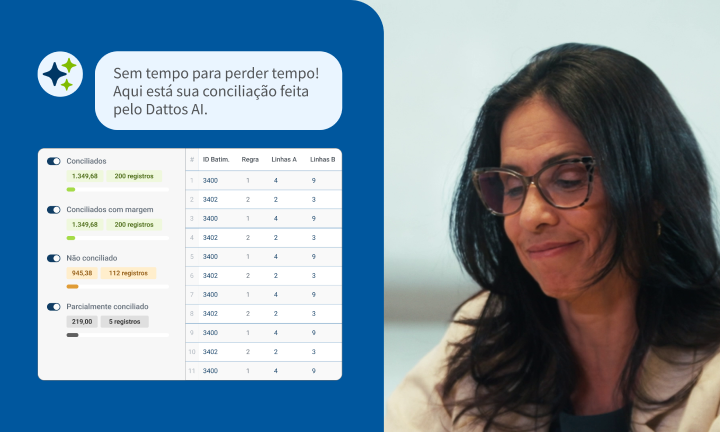

Como dados enviesados afetam o fechamento contábil?

O treinamento incorreto de dados para IA pode introduzir vieses que comprometem processos críticos, como o fechamento contábil. Dados incompletos, duplicados ou com categorizações imprecisas levam a resultados distorcidos, que não refletem a realidade financeira.

E é sempre necessário prestar atenção: esses erros impactam diretamente a confiabilidade dos relatórios e podem gerar decisões equivocadas, atrasos ou até não conformidades regulatórias.

3. Promova transparência nos sistemas de IA

Quando falamos em inteligência artificial, a transparência não é um “extra”, ela é indispensável. Sem entender como a IA toma decisões, como confiar que elas são justas e livres de erros? Em setores como finanças, onde decisões impactam vidas e negócios, promover a transparência é o primeiro passo para construir confiança.

Como colocar a transparência em prática?

1. Documentação aberta e acessível

Explique, com clareza, como os algoritmos foram treinados, quais dados foram utilizados e quais são os limites do sistema.

2. Modelos explicáveis

Priorize sistemas de IA que possam traduzir suas decisões em linguagem compreensível para todos os envolvidos, evitando a “caixa preta”.

3. Feedback contínuo

Abra canais para que usuários e stakeholders possam questionar resultados e sugerir melhorias.

4. Auditorias regulares

Revise o desempenho da IA para identificar possíveis desvios ou pontos cegos que comprometam sua eficácia.

4. Garanta que a IA respeite a privacidade dos usuários

No mundo da inteligência artificial, onde dados são o motor de quase todas as operações, respeitar a privacidade dos usuários não é apenas uma obrigação ética — é uma exigência para construir confiança e garantir conformidade com regulamentações, e você vai entender o porquê.

Por que a privacidade é crucial na IA?

Quando a IA coleta, armazena e processa dados pessoais, cada passo envolve riscos. Sem medidas claras para proteger essas informações, empresas podem enfrentar penalidades legais, além de perderem a confiança de clientes e parceiros.

Quais são os riscos de violar a privacidade?

1. Multas severas

Regulamentações como a LGPD e o GDPR aplicam multas milionárias para empresas que falham em proteger dados pessoais. Em alguns casos, essas penalidades podem comprometer financeiramente as operações.

2. Danos à reputação

Quebras de privacidade podem destruir a confiança dos clientes, impactando diretamente a marca e resultando em perda de mercado.

3. Impacto jurídico e penal

Além de multas, empresas podem enfrentar processos judiciais e sanções que inviabilizam suas atividades.

4. Perda de competitividade

Em mercados cada vez mais voltados à ética, empresas que desrespeitam a privacidade podem perder parceiros e investidores.

5. Vazamento de dados sensíveis

A falta de medidas de proteção expõe dados de clientes a cibercriminosos, gerando prejuízos financeiros e emocionais para os envolvidos.

5. Atentar-se às normas e regulamentações internacionais sobre ética em IA

Para que a inteligência artificial realmente funcione a favor das pessoas, é essencial que ela seja desenvolvida e usada com responsabilidade — e a melhor forma de garantir isso é seguir normas globais reconhecidas. Tais regulamentações são, além de regras técnicas, pilares que ajudam empresas a construir confiança e a minimizar riscos em um mundo cada vez mais digital.

Quais as principais normas aplicáveis?

1. ISO 38507

- Focada em governança da inteligência artificial, a norma ajuda organizações a integrar a ética na IA desde o planejamento até a implementação;

- Orienta sobre transparência, gestão de riscos e conformidade regulatória.

Já estamos no caminho: a Dattos segue rigorosamente a ISO 38507, conforme estabelecido em nossa Norma de Uso de IA, garantindo transparência, segurança de dados e monitoramento contínuo para assegurar a conformidade e confiança em suas soluções tecnológicas.

2. ISO/IEC 27001

- Voltada para a gestão da segurança da informação, esta norma estabelece controles rigorosos para proteger dados utilizados e gerados por sistemas de IA;

- Essencial para setores como finanças e saúde.

3. ISO 24029-1

- Concentra-se na avaliação de vieses e imparcialidade nos sistemas de IA, promovendo justiça nos resultados e decisões automatizadas.

Por que essas normas são importantes?

- Conformidade regulatória: seguir essas diretrizes ajuda a empresa a cumprir leis locais e internacionais, como LGPD e GDPR;

- Confiança do cliente: normas globais garantem que a IA seja desenvolvida de forma ética e segura, aumentando a credibilidade da organização;

- Prevenção de riscos: aplicar as ISOs reduz as chances de falhas, violações de dados e discriminação.

Como começar?

- Capacitação da equipe: treine os colaboradores para compreender e aplicar as normas;

- Parcerias estratégicas: trabalhe com consultorias especializadas em conformidade regulatória;

- Certificação: invista na certificação ISO para demonstrar compromisso com a ética e a segurança.